隨著大數據時代的到來,企業對數據處理和分析的需求日益復雜,既需要支持傳統的批處理任務,又要求能夠進行近實時分析,以快速響應業務變化。Apache Hudi(Hadoop Upserts, Deletes & Incrementals)作為一種開源數據湖解決方案,通過統一的存儲和服務層,成功解決了批處理和近實時分析之間的鴻溝,為現代數據架構提供了強大的支持。

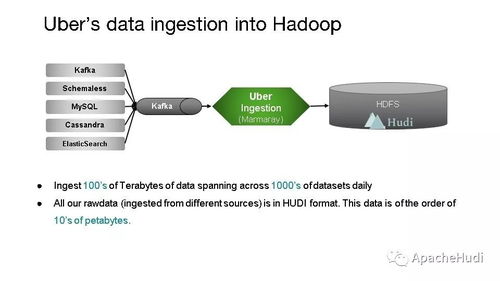

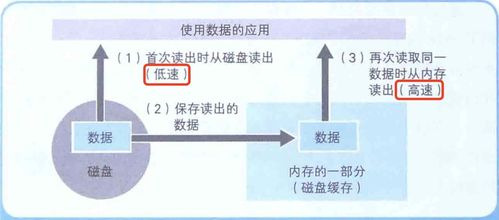

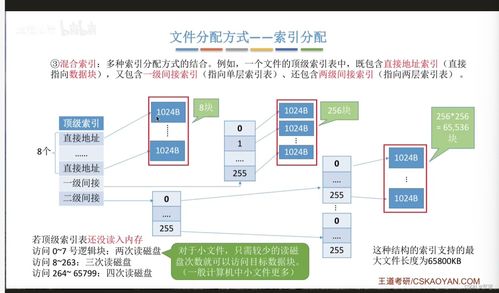

Hudi 的核心優勢在于其統一的數據存儲和處理能力。它構建在 Hadoop 兼容的存儲系統之上,如 HDFS 或云存儲(例如 AWS S3),允許用戶在同一數據湖中同時進行批處理(如每日 ETL 作業)和近實時分析(如流式數據攝取和查詢)。通過引入 Upsert(更新插入)和增量處理機制,Hudi 高效地管理數據變更,避免了傳統批處理中常見的全表重寫問題,從而降低了存儲成本并提高了處理效率。

在數據處理方面,Hudi 支持多種數據服務模式。例如,它提供了兩種表類型:Copy-on-Write(寫時復制)和 Merge-on-Read(讀時合并)。Copy-on-Write 表適用于寫操作較少的場景,通過直接在寫入時更新數據文件來保證查詢性能;而 Merge-on-Read 表則更適合高頻率的寫入場景,它將更新延遲到讀取時合并,從而優化寫入吞吐量,非常適合近實時數據流處理。這種靈活性使得 Hudi 能夠適應不同業務需求,無論是歷史數據分析還是實時監控。

對于存儲支持服務,Hudi 集成了多種大數據生態系統組件,如 Apache Spark、Apache Flink 和 Presto/Trino,提供了無縫的數據攝取、轉換和查詢體驗。用戶可以利用 Hudi 的增量拉取功能,僅處理自上次處理以來的新數據,這大大減少了計算資源消耗,并加速了數據管道。Hudi 還支持事務性保證和數據版本管理,確保數據的一致性和可追溯性,這對于企業級應用至關重要。

實際應用中,許多公司已將 Hudi 部署在生產環境中,用于統一處理批量和流式數據。例如,在電商平臺中,Hudi 可以同時處理歷史訂單的批分析(如月度銷售報告)和實時訂單流的近實時查詢(如庫存監控),實現了數據存儲和服務的統一。這不僅簡化了數據架構,還提升了整體數據處理的敏捷性和效率。

總而言之,Apache Hudi 通過其創新的存儲設計和數據處理服務,成功將批處理和近實時分析融合在一起。它降低了數據湖的維護復雜度,同時提供了高性能和可擴展性,是企業構建現代化數據平臺的理想選擇。隨著數據需求的不斷演進,Hudi 將繼續在統一數據處理領域發揮關鍵作用,助力企業實現更智能的數據驅動決策。